Ya hemos visto otros proyectos de IA generativa que han sido utilizados para crear imágenes falsas relacionadas con noticias de última hora, y es posible que ChatGPT también pueda ser utilizado de esta forma.

Es innegable el gran potencial que la inteligencia artificial, como el modelo de lenguaje ChatGPT, nos ha revelado. Sin embargo, también existe la posibilidad de que este potencial se utilice no solo con fines positivos, sino también con fines maliciosos.

Recientemente, ha salido a la luz que ChatGPT filtró datos de los usuarios, como correos electrónicos y datos de tarjetas de crédito, debido a un error. Este suceso ha generado preocupación en muchos usuarios, quienes han comenzado a pensar en cómo la tecnología podría ser utilizada para perjudicar a otros.

En este sentido, la Europol ha emitido un informe en el que advierte sobre los posibles peligros de utilizar modelos de lenguaje, como GPT, con fines criminales.

Aunque no ha proporcionado información específica sobre los delitos que se están cometiendo gracias a la IA, sí ha detallado las formas en las que esta tecnología podría ser aprovechada por los delincuentes.

¿Cómo puede ser utilizada ilegalmente?

La Europol ha expresado su pesimismo en cuanto a la capacidad de mejorar las capacidades de ChatGPT y otros modelos de lenguaje, afirmando que estos podrían ser explotados por criminales, quienes suelen ser muy rápidos en adaptarse a las nuevas tecnologías.

En concreto, la Europol ha identificado tres formas en las que ChatGPT podría ser utilizada para cometer delitos.

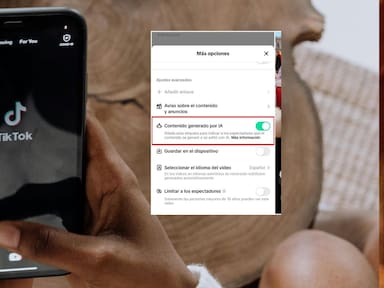

En primer lugar, la capacidad de ChatGPT para crear textos "realistas" lo hace una herramienta muy útil para el phishing, la técnica por la que el atacante se hace pasar por otra persona u organización.

Por ejemplo, cuando recibes un correo de tu banco que te pide iniciar sesión para aprobar una gran transferencia a tu cuenta. Esta técnica se puede detectar en parte gracias a la forma en que están maquetados y redactados los correos electrónicos, pero GPT-4 podría aprender a escribirlos en el estilo utilizado habitualmente en los correos reales, haciendo más fácil que caigamos en la trampa.

Además, la capacidad de ChatGPT para crear texto podría ser utilizada para crear propaganda y desinformación, e incluso para facilitar actividades terroristas.

Ya hemos visto otros proyectos de IA generativa que han sido utilizados para crear imágenes falsas relacionadas con noticias de última hora, y es posible que ChatGPT también pueda ser utilizado de esta forma.

Por último, la Europol ha advertido que las medidas tomadas por OpenAI para evitar el uso de ChatGPT para el cibercrimen son insuficientes, ya que solo funcionan si el modelo comprende lo que está haciendo. Los delincuentes pueden crear código malicioso, pidiendo a la IA que les escriba malware en partes para evitar que esta pueda comprender lo que está creando.

En resumen, aunque la inteligencia artificial tiene un gran potencial para mejorar nuestras vidas, también existe el riesgo de que sea utilizada con fines maliciosos. Es importante que los desarrolladores de esta tecnología trabajen en soluciones efectivas para evitar que los delincuentes la utilicen para causar daño.