La IA no puede "pensar por sí sola", ya que siempre hay personas detrás que han tomado una decisión

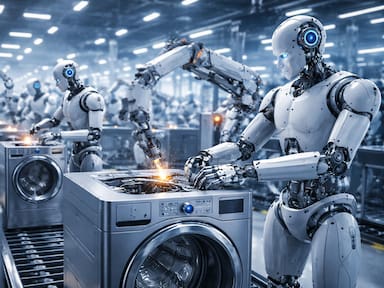

La semana pasada, la Unión Europea ha presentado una propuesta para limitar el desarrollo de la inteligencia artificial (IA) y garantizar que se respeten los derechos fundamentales.

La Comisión de Bruselas considera que los sistemas de alto riesgo deben ser "certificados, probados y controlados", de la misma manera que ocurre con los automóviles, los cosméticos y los juguetes.

Además, propone un etiquetado voluntario para otros sistemas de IA. El CEO de Google, Sundar Pichai, ha publicado recientemente una carta en la que expresa la necesidad de regular la IA, argumentando que los Estados deben abordar este desafío bajo el paraguas de una coordinación internacional construida sobre "un acuerdo sobre los valores fundamentales".

¿Qué podría salir mal?

Según Nuria Oliver, una de las mayores expertas en España en IA, el uso no ético de la IA puede tener efectos negativos, como la violación de la privacidad, la discriminación algorítmica, los sesgos, la falta de transparencia, la falta de veracidad en deepfakes o la manipulación subliminal del comportamiento humano.

En este sentido, el profesor del departamento de IA de la UPM, Jesús Cardeñosa, aclara que la IA no puede "pensar por sí sola", ya que siempre hay personas detrás que han tomado una decisión.

El coordinador del área de Derecho y Economía Digital de Gómez-Acebo & Pombo, Francisco Pérez Bes, señala que la falta de una regulación ética puede llevar a un aumento de injusticias, discriminaciones, daños y poner en peligro el propio sistema democrático.

La Unión Europea está convencida de la necesidad de regular la IA para liderar el enfoque ético respecto a esta tecnología y generar una ventaja competitiva para las empresas europeas. Sundar Pichai también aboga por una regulación que proporcione "una pauta general" y permita una implementación personalizada en diferentes sectores.