En pocas palabras, comenta que estas herramientas son mucho menos inteligentes de lo que se cree y están muy lejos de poder competir intelectualmente con los humanos en cualquier tarea.

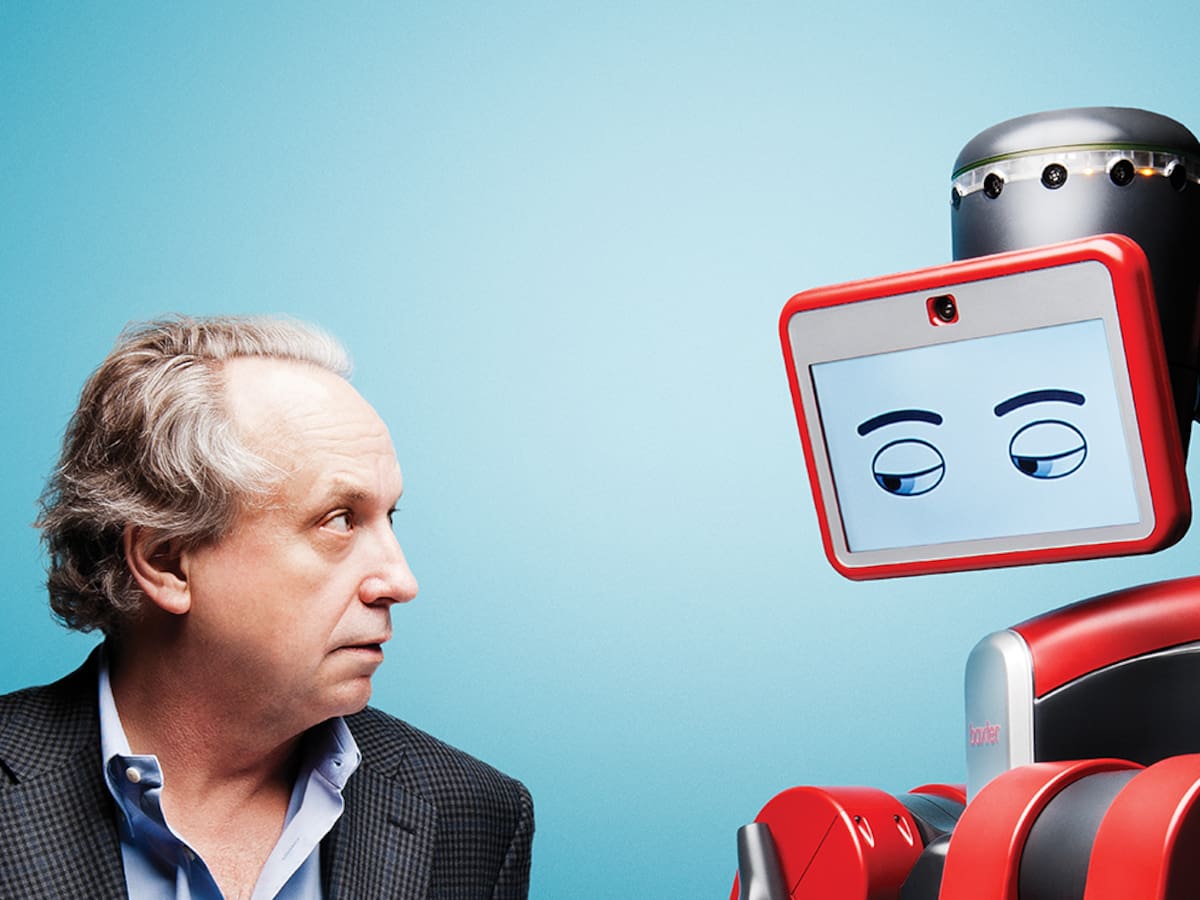

Rodney Brooks, un reconocido científico, ingeniero y emprendedor en el campo de la robótica y la inteligencia artificial, acaba de conceder una entrevista reveladora a la revista IEEE Spectrum donde aborda el futuro de la IA y, en particular, de ChatGPT.

Es posible que su nombre no te resulte familiar, pero es uno de los cofundadores de iRobot Corporation, empresa conocida por desarrollar el famoso robot aspirador Roomba y otros dispositivos.

Además, fundó Rethink Robotics y fue profesor en el Instituto Tecnológico de Massachusetts (MIT), donde dirigió el Laboratorio de Inteligencia Artificial y el Grupo de Robótica.

¿ChatGPT no es para tanto?

Con un amplio reconocimiento y respeto como autoridad en estos campos, Brooks destaca una idea que muchos otros expertos también consideran importante al hablar de esta tecnología que promete revolucionar el mercado laboral: la sobrevaloración de la IA y ChatGPT.

En pocas palabras, comenta que estas herramientas son mucho menos inteligentes de lo que se cree y están muy lejos de poder competir intelectualmente con los humanos en cualquier tarea.

En general, según él, la sociedad es responsable de estas predicciones catastrofistas sobre la inteligencia artificial.

Durante la extensa entrevista, se abordan diversos temas, pero uno que realmente preocupa es la idea de que la IA está a un paso de alcanzar la AGI, es decir, la Inteligencia Artificial General, que se refiere a la capacidad de una máquina para igualar o superar la inteligencia humana en una amplia gama de tareas cognitivas.

"Los modelos de lenguaje actuales no pueden inferir lógicamente el significado, a pesar de que parecen hacerlo, lo que puede engañar fácilmente al usuario", explica Brooks. "Lo que estos grandes modelos de lenguaje hacen bien es indicar cómo debería sonar una respuesta, pero eso es diferente de cómo debería ser una respuesta", añade.

En resumen, Brooks cree que los comentarios sobre futuras tecnologías "pueden llevar a algunos avances interesantes, pero no a la AGI".