Air Canada se vio forzada a devolver dinero a pasajero afectado por información incorrecta de chatbot

Después de una larga batalla legal, la aerolínea Air Canada se vio obligada a reembolsar parcialmente a un pasajero afectado por la mala información proporcionada por su chatbot sobre la política de viajes por duelo.

Jake Moffatt buscaba reservar un vuelo de emergencia tras la muerte de su abuela. Sin entender del todo las tarifas de duelo de Air Canada, acudió al chatbot de la aerolínea en busca de orientación.

Sin embargo, la información proporcionada por el chatbot resultó ser incorrecta, llevando a Moffatt a solicitar un reembolso que fue rechazado más tarde por la aerolínea.

Un enfrentamiento en la corte

Tras meses de intentos fallidos de obtener un reembolso adecuado, Moffatt rechazó un cupón de $200 ofrecido por Air Canada y llevó su queja ante un tribunal canadiense.

A pesar de los argumentos de la aerolínea, el tribunal falló a favor de Moffatt, ordenando a Air Canada a devolver una parte del dinero del boleto, además de daños adicionales.

Desactivación del chatbot

Curiosamente, al visitar recientemente el sitio web de Air Canada, el chatbot parecía haber sido desactivado, lo que plantea interrogantes sobre su futura disponibilidad y efectividad como herramienta de servicio al cliente.

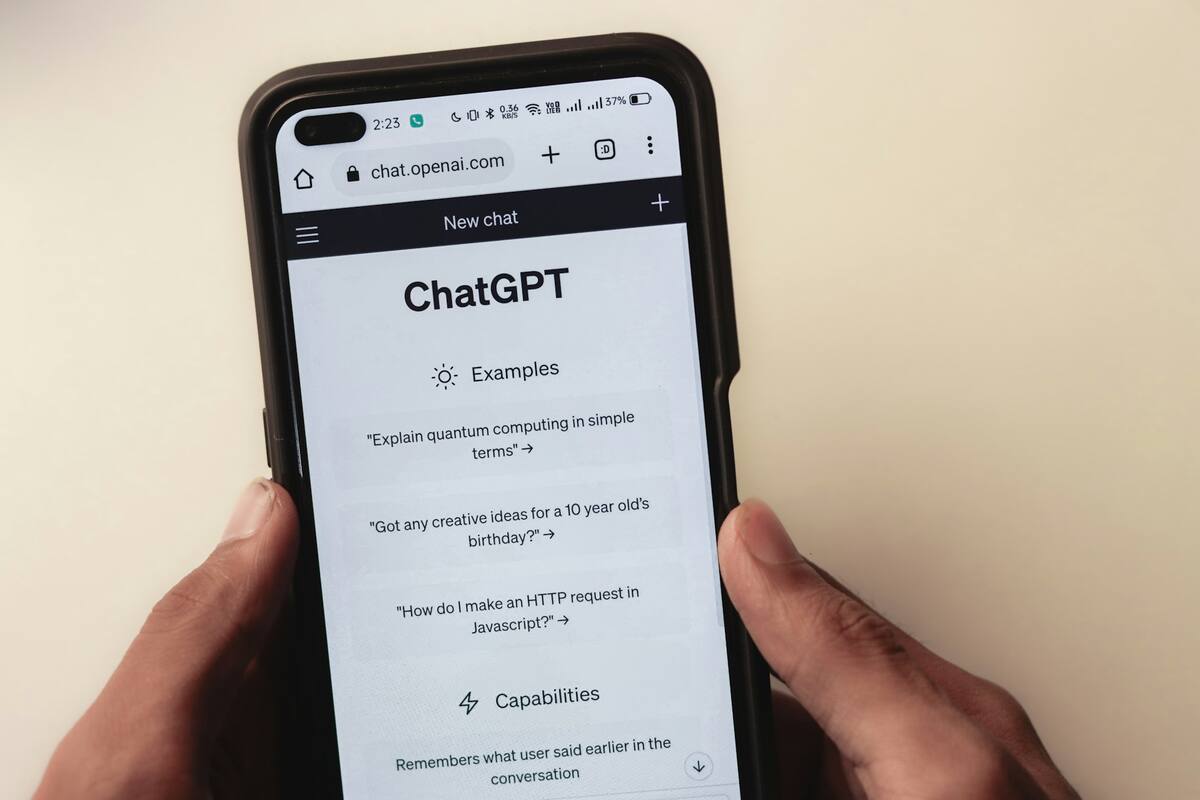

Este caso resalta la importancia de la precisión en la información proporcionada por los chatbots y el compromiso de las empresas con la satisfacción del cliente.

Expertos de Ars Technica sugirieron que Air Canada podría haber evitado problemas si su chatbot hubiera advertido sobre la posibilidad de información inexacta.

Aunque Air Canada argumentó que no debería ser responsable por las acciones de su chatbot, el tribunal decidió lo contrario, recordando a las empresas su responsabilidad de garantizar la precisión en todas las formas de interacción con los clientes.

Te puede interesar: VIDEO: OpenAI lanza “Sora”, Inteligencia Artificial generadora de los videos más realistas posibles