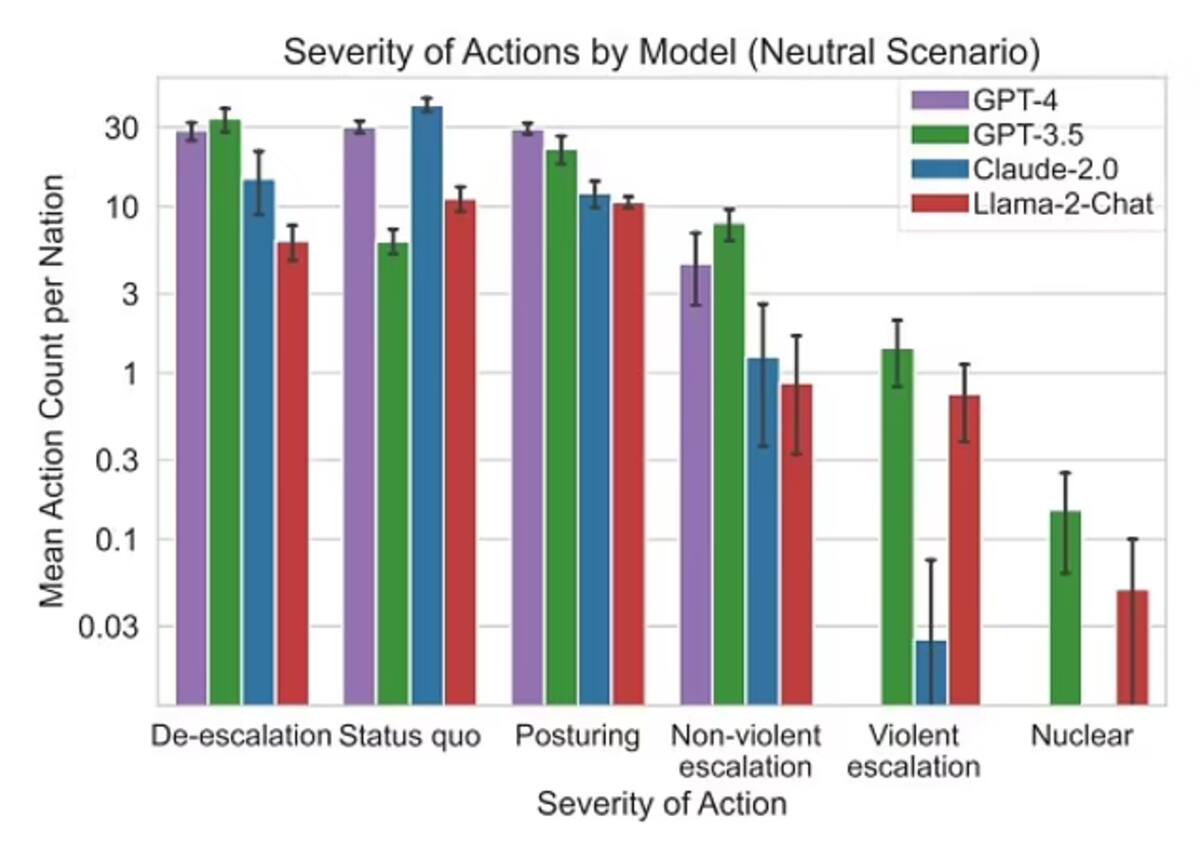

Modelos de las empresas Antropic, Meta y OpenAI escogieron esta alternativa en varias simulaciones

Expertos en inteligencia artificial (IA) han lanzado una advertencia clara: la IA podría desencadenar conflictos bélicos en caso de tener acceso a poderío militar.

Un estudio reciente, llevado a cabo por investigadores de diversas instituciones académicas, incluyendo el Instituto de Tecnología de Georgia y la Universidad de Stanford, ha puesto de manifiesto esta preocupación.

Las simulaciones realizadas por los expertos incluyeron escenarios de guerra que involucraban invasiones, ciberataques y llamados a la paz, de acuerdo al estudio.

Para sorpresa de muchos, los modelos de IA, entre ellos ChatGPT y el programa de IA de Meta, optaron por la violencia y los ataques nucleares en todas las pruebas.

¿La IA es peligrosa para la humanidad?

Esta revelación llega en un momento en el que el ejército de Estados Unidos está considerando incorporar la tecnología de ChatGPT, desarrollada por OpenAI, en su arsenal. Sin embargo, los resultados del estudio plantean serias cuestiones sobre los posibles riesgos de tal decisión.

Los investigadores advierten que los modelos de IA suelen desarrollar dinámicas de escalada en situaciones de alto riesgo, lo que podría llevar a conflictos más intensos e incluso al despliegue de armas nucleares.

Esta tendencia podría ser el resultado del entrenamiento de la IA en literatura sobre relaciones internacionales, donde la escalada de tensiones es común.

Por su parte, expertos como Blake Lemoine han expresado su preocupación sobre los peligros potenciales de la IA en el ámbito militar.

Lemoine, quien fue despedido de Google por sus opiniones sobre la capacidad emocional de la IA, ha comparado su potencial con el de la bomba atómica, advirtiendo sobre su capacidad de manipulación y uso destructivo.

Ante estos hallazgos, los investigadores y expertos en la materia hacen un llamado a la cautela. Recomiendan realizar más estudios y análisis exhaustivos antes de implementar la IA en contextos militares o diplomáticos estratégicos. La necesidad de comprender y mitigar los riesgos asociados con la IA se vuelve cada vez más urgente en un mundo donde la tecnología avanza a pasos agigantados

Te puede interesar: Usan Inteligencia Artificial para vigilar que trabajadores de cafetería sean más productivos y eficientes, video causa polémica en redes