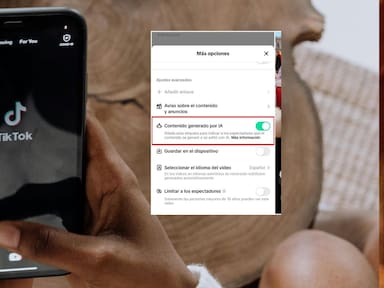

Este tipo de iniciativas se conocen como "hackeo ético", ya que se ponen a prueba los sistemas de seguridad de las empresas con su consentimiento y tienen el propósito de identificar brechas para reportarlas y solucionarlas antes de que puedan ser aprovechadas por terceros malintencionados.

La seguridad en el auge de la Inteligencia Artificial es un tema crítico y la Casa Blanca ha tomado medidas para poner a prueba la eficacia de los sistemas de IA.

En este sentido, se ha anunciado la realización de un evento durante la convención de seguridad cibernética DefCon en Las Vegas, en el que participarán alrededor de 4,000 hackers que evaluarán las herramientas de IA de las principales empresas del mercado.

El propósito de este ejercicio es generar datos relevantes sobre los efectos de la IA y proporcionar información crítica a los investigadores y al público en general.

Asimismo, permitirá a las empresas y desarrolladores de IA tomar medidas para solucionar los problemas identificados en sus modelos.

¿Para qué?

Empresas líderes en el desarrollo de IA, como Google, Microsoft y OpenaAI, serán evaluadas en este ejercicio. Durante la evaluación, estas empresas abrirán el código de sus programas para que los hackers puedan buscar vulnerabilidades o formas de eludir los mecanismos de seguridad de las herramientas.

Este tipo de iniciativas se conocen como "hackeo ético", ya que se ponen a prueba los sistemas de seguridad de las empresas con su consentimiento y tienen el propósito de identificar brechas para reportarlas y solucionarlas antes de que puedan ser aprovechadas por terceros malintencionados.

Expertos en ciberseguridad han destacado la importancia de este tipo de iniciativas para la transparencia del funcionamiento de la IA y para calmar las ansiedades de las personas en torno a esta tecnología.

Además, han subrayado la responsabilidad fundamental que tienen las empresas de tecnología de asegurarse de que sus productos sean seguros y protejan los derechos de las personas antes de que se implementen o se hagan públicos.

Esta iniciativa forma parte de un conjunto de medidas que el gobierno de los Estados Unidos ha impulsado para asegurar el funcionamiento de los sistemas de IA sin representar un riesgo para los usuarios. Otras medidas incluyen legislaciones para regular la IA y una inversión de 140 millones de dólares para lanzar siete nuevos Institutos Nacionales de Investigación de IA.